技術的特異点

ウィキペディアから、無料の百科事典

技術的特異点は-also、単に、特異点[1] -is仮定の技術成長は人間の文明に予測不可能な変化をもたらす、制御不能と不可逆になる時点を。[2] [3]インテリジェンス爆発と呼ばれる特異点仮説の最も人気のあるバージョンによると、アップグレード可能なインテリジェントエージェントは最終的に自己改善サイクルの「暴走反応」に入り、新しいよりインテリジェントな世代がますます急速に出現します、インテリジェンスの「爆発」を引き起こし、質的にすべてをはるかに超える強力なスーパーインテリジェンスをもたらしますヒューマンインテリジェンス。

技術的文脈における「特異点」の概念の最初の使用は、ジョン・フォン・ノイマンでした。[4] スタニスワフ・ウラムは「フォン・ノイマンとの議論を報告を中心に加速進歩技術といくつかの重要な近づくの外観与え、人間の生命のモードの変化の特異点を我々として、越えた人事のレースの歴史の中にそれらを知っている、続けることができなかった」。[5]その後の著者は、この見方を繰り返しています。[3] [6]

IJグッドの「インテリジェンス爆発」モデルは、将来の超知能が特異点を引き起こすと予測しています。[7]

概念と「特異点」という用語は、1993年のエッセイ「TheComing Technological Singularity」でヴァーナー・ヴィンジによって広められました。彼は、新しい超知能がそれ自体をアップグレードし続け、技術的に進歩するため、人間の時代の終わりを示すと書いています。理解できない速度で。彼は、それが2005年以前または2030年以降に起こった場合、彼は驚くだろうと書いた。[7]

スティーブンホーキングやイーロンマスクなどの公人は、完全な人工知能(AI)が人類の絶滅につながる可能性があることへの懸念を表明しています。[8] [9]特異点の結果と、人類に対するその潜在的な利益または害については、激しく議論されてきました。

ニック・ボストロムとヴィンセント・C・ミュラーが2012年と2013年に実施したAI研究者の4回の調査では、人工知能(AGI)が2040〜2050年までに開発される確率の中央値は50%であることが示唆されました。[10] [11]

バックグラウンド

技術の進歩はほとんどの分野で加速していますが(一部では減速していますが)、人間の脳の基本的な知性によって制限されています。ポールR.エーリッヒによれば、それは何千年もの間大幅に変化していません。[12]しかし、コンピューターやその他のテクノロジーの能力が高まるにつれ、最終的には人間よりもはるかにインテリジェントなマシンを構築できるようになる可能性があります。[13]

超人的知性が、人間の知性の増幅または人工知能のいずれかによって発明された場合、それは現在の人間ができるよりも優れた問題解決と発明のスキルをもたらすでしょう。このようなAIはシードAIと呼ばれます[14] [15]AIが人間の作成者と同等またはそれを超えるエンジニアリング機能で作成された場合、AIは独自のソフトウェアとハードウェアを自律的に改善したり、さらに高性能なマシンを設計したりする可能性があるためです。このより高性能なマシンは、さらに高性能のマシンを設計するために進むことができます。再帰的な自己改善のこれらの反復は加速する可能性があり、物理法則または理論的計算によって課せられる上限の前に、潜在的に巨大な質的変化を可能にします。多くの反復にわたって、そのようなAIは人間の認知能力をはるかに超えると推測されます。

インテリジェンス爆発

インテリジェンスの爆発は、人類が人工知能(AGI)を構築することで起こりうる結果です。AGIは、技術的特異点が達成された直後に、限界が不明な人工知能(ASI)の急速な出現につながる、再帰的な自己改善が可能である可能性があります。

IJグッドは、1965年に、人工知能が知能の爆発を引き起こす可能性があると推測しました。彼は、超人的な機械が発明されたとしても、その影響について推測しました:[16]

グッドのシナリオは次のように実行されます。コンピューターの能力が向上するにつれて、人々は人類よりもインテリジェントなマシンを構築することが可能になります。この超人的な知性は、現在の人間ができるよりも優れた問題解決と独創的なスキルを持っています。次に、この超知能マシンは、さらに高性能なマシンを設計するか、独自のソフトウェアを書き直してさらにインテリジェントにします。次に、この(さらに能力の高い)マシンは、さらに優れた能力のマシンを設計します。再帰的な自己改善のこれらの反復は加速し、物理法則または理論的計算によって課せられる上限の前に、巨大な質的変化を可能にします。[16]

その他の症状

スーパーインテリジェンスの出現

|

詳細情報:超知能 |

超知能、超知能、または超人的知性は、最も明るく才能のある人間の心の知性をはるかに超える知性を持っている架空のエージェントです。「スーパーインテリジェンス」は、そのようなエージェントが持つインテリジェンスの形式または程度を指す場合もあります。ジョン・フォン・ノイマン、ヴァーナー・ヴィンジ、レイ・カーツワイルは、スーパーインテリジェンスの技術的創造という観点から概念を定義しています。彼らは、現代の人間が特異点後の世界で人間の生活がどのようになるかを予測することは困難または不可能であると主張しています。[7] [17]

技術予測者と研究者は、人間の知性を超える可能性があるかどうか、またはいつ超える可能性があるかについて意見が分かれています。人工知能(AI)の進歩は、おそらく人間の認知的制限を欠く一般的な推論システムをもたらすだろうと主張する人もいます。他の人々は、人間が進化するか、生物学を直接修正して、根本的に優れた知性を達成すると信じています。多くの未来学のシナリオは、これらの可能性の両方からの要素を組み合わせており、人間が実質的な知能増幅を可能にする方法で、コンピューターとインターフェースをとったり、コンピューターに心をアップロードしたりする可能性が高いことを示唆しています。

非AI特異点

いくつかの作家は、次のような新しい技術によってもたらされた私たちの社会の中で任意の根本的な変化を参照してより広範な方法で、「特異点」を使用し、分子ナノテクノロジー、[18] [19] [20]、superintelligenceなしもののVingeや他の作家が、具体的な状態というこのような変更は、真の特異点とは見なされません。[7]

スピードスーパーインテリジェンス

速度超知能は、人間が実行できるすべてのことを実行できるAIを表します。唯一の違いは、マシンの実行速度が速いことです。[21]たとえば、情報処理の速度が人間の速度の100万倍に増加すると、主観的な1年は30物理秒で経過します。[22]情報処理速度のこのような違いは、特異点を促進する可能性があります。[23]

妥当性

多くの著名な技術者や学者には、技術的特異点の妥当性に異議を唱えるポール・アレン、ジェフ・ホーキンス、ジョン・ホランド、ジャロン・ラニアー、およびゴードン・ムーアその、法律しばしばコンセプトのサポートに引用されています。[24] [25] [26]

超人または作成するための最も提案されている方法transhuman人間の脳と人工知能の知能増幅:心は、2つのカテゴリに分類されます。インテリジェンス増強を生み出すための推測された方法は多く、バイオエンジニアリング、遺伝子工学、向知性薬、AIアシスタント、直接のブレインコンピューターインターフェース、マインドアップロードなどがあります。インテリジェンス爆発への複数のパスが調査されているため、特異点が発生する可能性が高くなります。特異点が発生しないためには、それらはすべて失敗する必要があります。[22]

ロビン・ハンソンは、人間の知性の増強に対する懐疑論を表明し、人間の知性を高めるための簡単な方法の「手に負えない成果」が尽きると、さらなる改善を見つけるのはますます困難になるだろうと書いた。[27]人間の知性を増幅するためのすべての推測された方法にもかかわらず、非人間の人工知能(特にシードAI)は、特異点を前進させる仮説の中で最も人気のあるオプションです。[要出典]

インテリジェンス爆発が発生するかどうかは、3つの要因に依存します。[28]最初の加速要因は、以前の各改善によって可能になった新しいインテリジェンスの強化です。逆に、インテリジェンスがより高度になるにつれて、さらなる進歩はますます複雑になり、おそらくインテリジェンスの増加の利点を克服します。特異点への動きを継続するには、各改善により、平均して少なくとももう1つの改善が必要です。最後に、物理法則は最終的にそれ以上の改善を妨げるでしょう。

インテリジェンスの向上には、論理的に独立しているが相互に補強し合う2つの原因があります。それは、計算速度の向上と、使用されるアルゴリズムの向上です。[29]前者は、ムーアの法則と予測されるハードウェアの改善[30]によって予測されており、以前の技術的進歩と比較的類似しています。しかし、AI研究者もいます[誰ですか?]ソフトウェアがハードウェアよりも重要であると信じている人。[31]

2015年のNeurIPSおよびICML機械学習会議で出版された著者の2017年の電子メール調査では、インテリジェンス爆発の可能性について質問されました。回答者のうち、12%が「かなり可能性が高い」、17%が「可能性が高い」、21%が「ほぼ均等」、24%が「可能性が低い」、26%が「非常に可能性が低い」と回答しました。 "。[32]

速度の向上

人間と人工知能の両方で、ハードウェアの改善により、将来のハードウェアの改善率が高まります。簡単に言えば、[33] ムーアの法則は、速度の最初の2倍が18か月かかった場合、2番目の速度は主観的な18か月かかることを示唆しています。または外部9か月、その後、4か月、2か月など、速度の特異点に向けて。[34]速度の上限に達する可能性がありますが、これがどれほど高いかは不明です。ジェフ・ホーキンスは、自己改善型コンピューターシステムは必然的に計算能力の上限に達するだろうと述べています。少し早くそこに着きます。特異点はありません。」[35]

シリコンベースのハードウェアをニューロンと直接比較することは困難です。しかし、Berglas(2008)は、コンピューターの音声認識が人間の能力に近づいており、この能力には脳の体積の0.01%が必要であると述べています。このアナロジーは、現代のコンピューターハードウェアが人間の脳と同じくらい強力である数桁以内にあることを示唆しています。

指数関数的成長

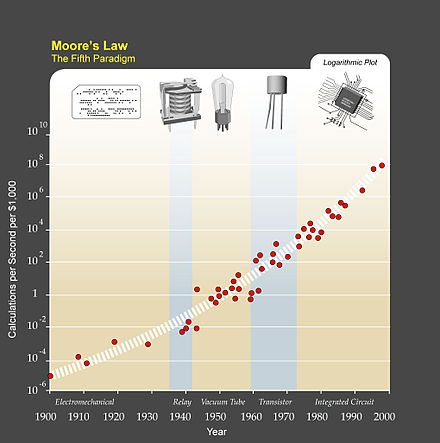

ムーアの法則によって示唆されるコンピューティング技術の指数関数的成長は、比較的近い将来に特異点を期待する理由として一般的に引用されており、多くの著者がムーアの法則の一般化を提案しています。コンピューター科学者で未来派のハンス・モラベックは、1998年の本[36]で、指数関数的成長曲線を集積回路以前の初期のコンピューティング技術にまで拡張できると提案しました。

レイ・カーツワイルは、技術変化の速度(より一般的にはすべての進化過程[37])が指数関数的に増加する収益加速の法則を仮定し、モラベックの提案と同じ方法でムーアの法則を一般化し、材料技術(特に適用される場合)も含めますナノテクノロジー)、医療技術など。[38] 1986年から2007年の間に、1人あたりの情報を計算するマシンのアプリケーション固有の能力は14か月ごとに約2倍になりました。世界の汎用コンピュータの1人当たりの容量は18か月ごとに2倍になっています。一人当たりの世界の通信容量は34か月ごとに2倍になりました。そして、一人当たりの世界のストレージ容量は、40か月ごとに2倍になりました。[39]一方、21世紀の特異点をパラメータとするグローバルな加速パターンは、指数関数的ではなく双曲線的として特徴付けられるべきであると主張されてきました。[40]

カーツワイルは、(他の技術とは対照的に)人工知能の急速な増加のために「特異点」という用語を予約し、たとえば「特異点は、私たちの生体と脳のこれらの制限を超越することを可能にします...区別はありません、ポスト特異点、人間と機械の間」。[41]彼はまた、コンピューターベースの知性が人間の脳力の合計を大幅に超えると予想する時期に関して、特異点の予測日(2045)を定義し、その日付より前にコンピューティングが進歩すると「特異点を表さない」と書いている。彼らは「まだ私たちの知性の深遠な拡大に対応していない」からです。[42]

変化の加速

|

主な記事:変化の加速 |

一部の特異点支持者は、過去の傾向、特に技術の改善間のギャップの短縮に関連する傾向の外挿を通じて、その必然性を主張しています。技術的進歩の文脈における「特異点」という用語の最初の使用法の1つで、スタニスワフ・ウラムは、変化の加速についてジョン・フォン・ノイマンとの会話について語っています。

カーツワイルは、技術の進歩は、彼が「収穫加速の法則」と呼んでいるものに従って、指数関数的成長のパターンに従うと主張しています。テクノロジーが障壁に近づくときはいつでも、カーツワイルは書いています、新しいテクノロジーはそれを乗り越えます。彼は、パラダイムシフトがますます一般的になり、「技術の変化が非常に急速で深刻になり、人類の歴史の構造の崩壊を表す」と予測しています。[43]カーツウェルは、特異点が約2045年までに発生すると考えています。[38]彼の予測は、ヴィンジの急速に自己改善する超人的知性ではなく、特異点への漸進的な上昇を予測するという点で、ヴィンジの予測とは異なります。

よく引用される危険には、分子ナノテクノロジーや遺伝子工学に一般的に関連する危険が含まれます。これらの脅威は、特異点の支持者と批評家の両方にとって大きな問題であり、ビル・ジョイのワイアード誌の記事「なぜ未来は私たちを必要としないのか」の主題でした。[6] [44]

アルゴリズムの改善

「シードAI」[14] [15]のような一部のインテリジェンス技術は、ソースコードを変更することで、自分自身を高速化するだけでなく、より効率的にする可能性もあります。これらの改善により、さらなる改善が可能になり、さらなる改善が可能になります。

再帰的に自己改善する一連のアルゴリズムのメカニズムは、2つの点で生の計算速度の向上とは異なります。まず、外部からの影響は必要ありません。より高速なハードウェアを設計するマシンでは、改良されたハードウェアを作成するか、工場を適切にプログラムする必要があります。[要出典] AIが独自のソースコードを書き換えると、AIボックスに含まれている間にそれを行うことができます。

第二に、ヴァーナーヴィンジの特異点の概念と同様に、結果を予測することははるかに困難です。速度の向上は人間の知性との量的な違いにすぎないように見えますが、実際のアルゴリズムの改善は質的に異なります。エリーザー・ユドコウスキーは、それを人間の知性がもたらした変化と比較しています。人間は、進化が行ったよりも何千倍も速く、まったく異なる方法で世界を変えました。同様に、生命の進化は、以前の地質学的変化率からの大規模な逸脱と加速であり、知性の向上により、変化が再び同じように異なる可能性があります。[45]

再帰的に自己改善する一連のアルゴリズムに起因するインテリジェンス爆発の特異点に関連する重大な危険があります。まず、AIの目標構造は自己改善の下で不変ではない可能性があり、AIが本来意図されていたもの以外のものに最適化される可能性があります。[46] [47]第二に、AIは、人類が生き残るために使用するのと同じ希少な資源を求めて競争する可能性があります。[48] [49]

積極的に悪意を持っているわけではありませんが、AIがそのようにプログラムできない限り、AIが積極的に人間の目標を推進し、そうでない場合は、人類を支援するために現在使用されているリソースを使用してオウンゴールを推進し、人類の絶滅を引き起こすと考える理由はありません。[50] [51] [52]

CarlShulmanとAndersSandbergは、アルゴリズムの改善が特異点の制限要因である可能性があることを示唆しています。ハードウェアの効率は着実なペースで向上する傾向がありますが、ソフトウェアの革新はより予測不可能であり、一連の累積的な調査によってボトルネックになる可能性があります。彼らは、ソフトウェアが制限された特異点の場合、ハードウェアが制限された特異点よりもインテリジェンスの爆発が実際に起こりやすくなることを示唆しています。ソフトウェアが制限された場合、人間レベルのAIが開発されると、非常に高速なハードウェアと豊富な安価なハードウェアにより、AI研究の制約が緩和されます。[53]ソフトウェアがそれを使用する方法を理解すると解き放たれることができる豊富な蓄積されたハードウェアは、「コンピューティングオーバーハング」と呼ばれています。[54]

批判

哲学者のヒューバート・ドレイファスのような批評家の中には、コンピューターや機械は人間の知性を達成できないと主張する人もいれば、物理学者のスティーブン・ホーキングのように、最終的な結果が同じであれば知性の定義は無関係であると主張する人もいます。[55]

心理学者のスティーブンピンカーは2008年に次のように述べています。

カリフォルニア大学バークレー校、哲学の教授ジョン・サールは書いています:

マーティン・フォードでのトンネルでライト:オートメーション、技術と未来の経済を加速[57]公準A「技術のパラドックス」という点で、これは、Aを必要とするので、特異点は、自動化されるだろう経済の中で最も日常の仕事を発生する可能性がある前に、特異点より劣る技術レベル。これは、大規模な失業と消費者の需要の急落を引き起こし、その結果、特異点をもたらすために必要となるテクノロジーに投資するインセンティブを破壊します。仕事の移動は、伝統的に「日常的」と考えられてきた仕事にますます制限されなくなりました。[58]

セオドアモディス[59]とジョナサンヒューブナー[60]は、技術革新の速度が上昇しなくなっただけでなく、実際には低下していると主張しています。この低下の証拠は、回路密度が指数関数的に増加するというムーアの予測が維持されているにもかかわらず、コンピュータのクロックレートの上昇が鈍化していることです。これは、チップからの過度の熱の蓄積によるものであり、高速で動作しているときにチップが溶けるのを防ぐのに十分な速さで放散することはできません。より電力効率の高いCPU設計とマルチセルプロセッサにより、将来的に速度の向上が可能になる可能性があります。[61]カーツワイルはモディスのリソースを使用し、モディスの仕事は変化を加速することでしたが、モディスはカーツワイルの「技術的特異点」の論文から距離を置き、科学的な厳密さが欠けていると主張しました。[62]

詳細な経験的会計であるTheProgress of Computingの中で、William Nordhausは、1940年以前は、コンピューターは従来の産業経済の成長がはるかに遅いため、19世紀のコンピューターへのムーアの法則の外挿を拒否したと主張しました。[63]

2007年の論文で、シュミットフーバーは主観的に「注目すべき出来事」の頻度が21世紀の特異点に近づいているように見えると述べましたが、読者に主観的な出来事のそのようなプロットを一粒の塩で取るように警告しました:おそらく最近と遠い記憶の違いイベントは、何も存在しない場合に変化を加速するという幻想を生み出す可能性があります。[64]

ポール・アレンは、リターンを加速することの反対である複雑さのブレーキを主張しました。[26]科学が知性の理解に向けて進歩すればするほど、さらなる進歩を遂げることは難しくなります。示唆されるように、人間の創造性は、加速リターンを示すが、実際にはないことを特許ショーの数の研究ジョゼフ・タインター彼の中で複雑な社会の崩壊、[65]の法則収穫逓減。1000件あたりの特許数は1850年から1900年にかけてピークに達し、その後減少傾向にあります。[60]複雑さの増大は最終的に自己制限的になり、広範囲にわたる「一般的なシステムの崩壊」につながります。

ジャロン・ラニアーは、特異点が不可避であるという考えに反論しています。彼は次のように述べています。「テクノロジーがそれ自体を生み出しているとは思いません。それは自律的なプロセスではありません。」[66]彼は主張するために行く:「技術決定の上に人間の代理店を信じるに足る理由があなたがして、人々が自分の道を獲得し、自分の生活を考案経済を持つことができるということです、あなたが上で社会を構築する場合。ない個々の人間を強調しますエージェンシー、それは人々の影響力、尊厳、そして自己決定を否定することと運用上同じことです... [特異性の考え]を受け入れることは悪いデータと悪い政治を祝うことになるでしょう。」[66]

エコノミストの ロバート・J・ゴードンは、「アメリカの成長の興亡:内戦以来の米国の生活水準」(2016年)で、測定された経済成長は1970年頃に減速し、2007年から2008年の金融危機以降さらに減速したと指摘しています。、そして経済データは数学者IJグッドによって想像されたように来たるべき特異点の痕跡を示さないと主張します。[67]

特異点の概念に対する一般的な批判に加えて、いくつかの批評家はカーツワイルの象徴的なチャートに問題を提起しました。批判の1つの線は、この性質の両対数グラフが本質的に直線的な結果に偏っているということです。他の人は、カーツワイルが使用することを選択したポイントの選択バイアスを特定します。たとえば、生物学者のPZマイヤーズは、初期の進化の「イベント」の多くは恣意的に選ばれたと指摘しています。[68]カーツワイルは、15の中立的な情報源からの進化的イベントをグラフ化し、それらが両対数グラフ上で直線に適合することを示すことによって、これに反論しました。エコノミストかみそりの刃の数が1から5にまで増加し、これまでになく速く無限に増加することを推定するグラフで、この概念をあざけりました。[69]

潜在的な影響

技術の進歩により、過去に経済成長率の劇的な変化が起こった。人口増加に基づくと、旧石器時代から新石器革命まで、経済は25万年ごとに倍増しました。新しい農業経済は900年ごとに倍増し、目覚ましい成長を遂げました。産業革命を皮切りに、現在の時代、世界の経済生産高は15年ごとに2倍になり、農業時代の60倍の速さです。超人的な知性の台頭が同様の革命を引き起こすならば、ロビン・ハンソンは、経済が少なくとも四半期ごとに、そしておそらく週ごとに倍増すると予想するだろうと主張します。[70]

不確実性とリスク

|

詳細情報:人工知能による既存のリスク |

「技術的特異点」という用語は、そのような変化が突然起こる可能性があり、結果として生じる新しい世界がどのように機能するかを予測することは難しいという考えを反映しています。[71] [72]特異点をもたらす知性の爆発が有益であるか有害であるか、あるいは実存的脅威でさえあるかどうかは不明である。[73] [74] AIは特異点リスクの主要な要因であるため、Future of Humanity Institute、Machine Intelligence Research Instituteなど、多くの組織がAIの目標システムを人間の価値観に合わせる技術理論を追求しています[71]。人間互換人工知能のためのセンター、およびライフインスティテュートの未来。

物理学者のスティーブンホーキング氏は2014年に、「AIの作成の成功は人類史上最大のイベントになるでしょう。残念ながら、リスクを回避する方法を学ばなければ、それが最後になるかもしれません」と述べています。[75]ホーキングは、今後数十年で、AIは「金融市場を凌駕する技術、人間の研究者の発明、人間の指導者の巧妙な操作、そして私たちが理解することさえできない武器の開発」などの「計り知れない利益とリスク」を提供できると信じていた。[75]ホーキングは、人工知能をもっと真剣に受け止め、特異点に備えるためにもっと多くのことをすべきだと提案した:[75]

Berglas(2008)は、AIが人間に優しいという直接的な進化の動機はないと主張しています。進化には、人間が評価する結果を生み出す固有の傾向はなく、AIが作成者の意図しない方法で不注意に動作するのではなく、任意の最適化プロセスが人類が望む結果を促進することを期待する理由はほとんどありません。[76] [77] [78] アンダース・サンドバーグもこのシナリオについて詳しく説明し、さまざまな一般的な反論に取り組んでいます。[79] AI研究者ヒューゴ・デ・ガリスは、人工知能は単に人類排除することができることを示唆している希少資源にアクセスするために、[48] [80]そして人間は彼らを止める力がないでしょう。[81]あるいは、自分たちの生存を促進するという進化の圧力の下で開発されたAIは、人類を打ち負かす可能性がある。[52]

Bostrom(2002)は、人類の絶滅のシナリオについて論じ、考えられる原因としてスーパーインテリジェンスを挙げています。

Eliezer Yudkowskyによると、AIの安全性における重大な問題は、友好的でない人工知能は友好的なAIよりもはるかに簡単に作成できる可能性が高いということです。どちらも再帰的最適化プロセス設計の大幅な進歩を必要としますが、フレンドリーAIには、自己改善の下で目標構造を不変にする機能(または、AIがそれ自体を非フレンドリーなものに変換する可能性がある)と、人間の価値観と一致し、自動的には行われない目標構造も必要です。人類を破壊します。一方、非友好的なAIは、自己修正の下で不変である必要がない任意の目標構造に最適化できます。[82] Bill Hibbard(2014)は、自己妄想を含むいくつかの危険を回避するAI設計を提案しています[83]。 意図しない目的合理的行為[46] [84]および報酬ジェネレーターの破損。[84]彼はまた、AIの社会的影響[85]とAIのテストについても論じています。[86]彼の2001年の著書Super-IntelligentMachinesは、AIとAIに対する公的管理についての公教育の必要性を提唱しています。また、報酬ジェネレーターの破損に対して脆弱なシンプルなデザインを提案しました。

社会生物学的進化の次のステップ

|

詳細情報:社会文化的進化 |

技術的特異点は通常突然の出来事と見なされますが、一部の学者は、現在の変化の速度はすでにこの説明に適合していると主張しています。[要出典]

さらに、テクノロジー、生物学、社会が融合する大きな進化の転換期にあるとの意見もあります。デジタルテクノロジーは、人間社会の構造に、議論の余地のない、しばしば生命を維持する依存の程度まで浸透してきました。

Trends in Ecology&Evolutionの2016年の記事は、「人間はすでに生物学とテクノロジーの融合を受け入れています。私たちは目覚めている時間のほとんどをデジタルを介したチャネルを介して通信することに費やしています...私たちは車や自動操縦装置のアンチロックブレーキを通じて人工知能を私たちの生活に信頼しています飛行機の中で...アメリカでの結婚の3分の1がオンラインで始まり、デジタルアルゴリズムも人間のペアの結合と複製に役割を果たしています。」

この記事はさらに、進化の観点から、進化における以前のいくつかの主要な移行が、情報の保存と複製(RNA、DNA、多細胞性、文化と言語)の革新を通じて人生を変えたと主張しています。生命の進化の現段階では、炭素ベースの生物圏は、同等の進化の移行をもたらす技術を生み出すことができる認知システム(人間)を生み出しました。

人間が作成したデジタル情報は、生物圏の生物学的情報と同様の規模に達しています。1980年代以降、保存されるデジタル情報の量は約2。5年ごとに倍増し、2014年には約5ゼッタバイト(5 × 10 21バイト)に達しました。[88]

生物学的には、地球上には72億人の人間がおり、それぞれが62億ヌクレオチドのゲノムを持っています。1つのバイトは、4つのヌクレオチド対をコードすることができるため、地球上のすべての人間の個体のゲノムは、約1によってコードされ得る× 10 19バイト。デジタルレルムは、2014年にこれより500倍多くの情報を保存しました(図を参照)。DNAの総量は、地球上の全てのセルに含まれる5.3程度であると推定される× 10 37 1.325に相当する塩基対、× 10 37情報のバイト。

デジタルストレージの成長が現在の年平均成長率30〜38%で継続する場合、[39]約110年で地球上のすべての細胞のすべてのDNAに含まれるすべての情報コンテンツに匹敵します。これは、わずか150年の合計期間にわたって生物圏に保存された情報の量が2倍になることを意味します。」[87]

人間社会への影響

|

詳細情報:フィクションにおける人工知能 |

2009年2月、米国人工知能学会(AAAI)の後援の下、エリックホーヴィッツは、カリフォルニア州パシフィックグローブのアシロマーで一流のコンピューター科学者、人工知能研究者、ロボット工学者の会議の議長を務めました。目標は、ロボットが自給自足になり、独自の決定を下せるようになるという仮想的な可能性の潜在的な影響について議論することでした。彼らは、コンピューターとロボットが自律性を獲得できる範囲と、そのような能力をどの程度使用して脅威や危険をもたらすことができるかについて話し合った。[89]

一部のマシンは、独自の電源を見つけたり、武器で攻撃するターゲットを選択したりする機能など、さまざまな形式の半自律性でプログラムされています。また、一部のコンピュータウイルスは排除を回避できるため、出席した科学者によると、機械知能の「ゴキブリ」段階に到達したと言えます。会議の参加者は、サイエンスフィクションに描かれているような自己認識はおそらくありそうもないが、他の潜在的な危険と落とし穴が存在することを指摘しました。[89]

フランク・S・ロビンソンは、人間が人間の知性を備えた機械を実現すると、科学的および技術的な問題は、人間よりもはるかに優れた頭脳で取り組み、解決されると予測しています。彼は、人工システムは人間よりも直接的にデータを共有できると述べ、これが人間の能力を矮小化する超知性のグローバルネットワークをもたらすと予測しています。[90]ロビンソンはまた、そのような知性の爆発の後、未来がどれほど大きく異なる可能性があるかについても論じています。この一例は太陽エネルギーであり、地球は人類が捕らえるよりもはるかに多くの太陽エネルギーを受け取るので、その太陽エネルギーをもっと捕まえることは文明の成長に大きな期待を抱くでしょう。

ハード対ソフト離陸

ハードテイクオフのシナリオでは、AGIは急速に自己改善し、世界を「制御」します(おそらく数時間で)。人間が開始した重大なエラー修正やAGIの目標の段階的な調整には速すぎます。ソフトテイクオフのシナリオでは、AGIは依然として人類よりもはるかに強力になりますが、継続的な人間の相互作用と修正がAGIの開発を効果的に導くことができるタイムスケールで、人間のようなペース(おそらく数十年程度)で行われます。[92] [93]

ラメズナムは、ハードな離陸に反対している。彼は、企業などの超知能による再帰的な自己改善がすでに見られていると指摘しています。たとえば、Intelは、「より優れたCPUを設計するために、数万人の人間とおそらく数百万のCPUコアの集合的な頭脳を持っています!」ただし、これは難しい離陸にはつながりませんでした。むしろ、それはムーアの法則の形でソフトな離陸につながりました。[94] Naamはさらに、より高い知性の計算の複雑さは線形よりもはるかに大きい可能性があることを指摘し、「知性の精神2を作成することはおそらく知性の精神1を作成することの2倍以上難しい」。[95]

J. Storrs Hallは、AIが劇的な成果を上げるために、「夜間のハードテイクオフでよく見られるシナリオの多くは循環的であり、自己改善プロセスの開始点で超人的な能力を前提としているようです」と考えています。 、離陸に必要なドメイン全般の改善。Hallは、ハードウェア、ソフトウェア、インフラストラクチャをすべて独自に再帰的に自己改善するのではなく、最も効果的な1つの領域に特化して、市場で残りのコンポーネントを購入する方が、品質が高いためだと示唆しています。市場に出回っている製品の数は絶えず向上しており、AIは世界の他の地域で使用されている最先端のテクノロジーに追いつくのに苦労するでしょう。[96]

Ben Goertzelは、新しい人間レベルのAIは、その知性を利用して富を蓄積するのに適しているというHallの提案に同意します。AIの才能は、企業や政府にそのソフトウェアを社会全体に分散させるように促すかもしれません。ゲルツェルは5分間の激しい離陸には懐疑的ですが、人間から超人間レベルへの5年程度の離陸は合理的であると推測しています。Goerzelは、このシナリオを「セミハード離陸」と呼んでいます。[97]

マックスモア超高速の人間レベルのAIがほんの少ししかない場合でも、他の人に頼って物事を成し遂げ、人間の認知的制約があるため、世界を根本的に変えることはないと主張し、反対します。すべての超高速AIが知能増強に取り組んだとしても、進歩の速度は上がるものの、なぜそれらが既存の人間の認知科学者よりも不連続な方法で超人間の知能を生み出すのに優れているのかは不明です。さらに、超知能は一夜にして世界を変えることはないだろうと主張します。超知能は、世界に物理的な影響を与えるために、既存の遅い人間のシステムと関わりを持つ必要があります。「組織のためのコラボレーションの必要性、[98]

不死

カーツワイルは、2005年の著書『シンギュラリティは近い』で、医学の進歩により、人々が老化の影響から体を保護し、平均余命を無限に延ばすことができると示唆しています。カーツワイルは、医学の技術的進歩により、私たちの体の欠陥のある部品を継続的に修理および交換し、寿命を未定の年齢まで延ばすことができると主張しています。[99]カーツワイルは、現在のバイオエンジニアリングの進歩について議論することにより、彼の議論をさらに強化している。カーツワイルは体細胞遺伝子治療を提案しています。特定の遺伝子情報を持つ合成ウイルスの後、次のステップは、この技術を遺伝子治療に適用し、ヒトDNAを合成遺伝子に置き換えることです。[100]

ナノテクノロジーの創設者の1人であるK.エリックドレクスラーは、1986年の著書 『創造する機械』で、細胞内で動作し、まだ架空の生物学的機械を利用しているものを含む、細胞修復装置を仮定しました。

リチャード・ファインマンによれば、ファインマンの理論的マイクロマシンの医学的使用のアイデアを最初に彼に提案したのは、彼の元大学院生であり共同研究者であったアルバート・ヒブスでした(1959年頃)。ヒブスは、特定の修理機械は、理論的には(ファインマンが言ったように)「医者を飲み込む」ことができるようになるまで、いつかサイズが縮小されるかもしれないと示唆した。このアイデアは、ファインマンの1959年のエッセイ「底にたくさんの部屋があります」に組み込まれました。[101]

ジャロン・ラニアーは、単に肉体の動作寿命を延ばすだけでなく、「人々が肉体で死に、コンピューターにアップロードされ、意識を維持する」ことを含む「デジタルアセンション」と呼ばれる不死の形態を主張します。[102]

コンセプトの歴史

発表されたマヘンドラ・プラサドによる論文、AIマガジンは、18世紀の数学者と主張しているコンドルセ侯爵は仮定と数学的知性の爆発と人類への影響をモデル化するために最初の人でした。[103]

このアイデアの初期の説明は、ジョン・ウッド・キャンベル・ジュニアの1932年の短編小説「最後の進化」で行われました。

1958年のジョン・フォン・ノイマンの訃報で、ウラムはフォン・ノイマンとの会話を思い出しました。「テクノロジーの進歩と人間の生活様式の変化が加速し、それを超えるとレースの歴史の中でいくつかの本質的な特異点に近づいているように見えます。私たちが知っているように、人事は続けることができませんでした。」[5]

1965年、グッドは、機械知能の再帰的な自己改善の「知能爆発」を仮定したエッセイを書きました。

1981年、スタニスワフレムは、SF小説のゴーレムXIVを出版しました。それは、意識を獲得し、彼自身の知性を高め始め、個人の技術的特異点に向かって移動する軍用AIコンピューター(ゴーレムXIV)について説明しています。ゴーレムXIVは元々、建設業者が戦争と戦うのを支援するために作成されましたが、その知性が人間よりもはるかに高いレベルに進むと、内部の論理的一貫性が欠如しているため、軍事要件への関心がなくなります。

1983年に、ヴァーナーヴィンジは、オムニ誌の1983年1月号で印刷されたトピックに最初に取り組んだ多くの著作でグッドの知性の爆発を大いに広めました。この論説では、Vingeは、インテリジェントマシンの作成に特に結びついた方法で「特異点」という用語を最初に使用したようです。[104] [105]

1985年の「人工知能のタイムスケール」で、人工知能の研究者レイ・ソロモノフは、彼が「無限遠点」と呼んだものの関連する概念を数学的に明確にしました。人間レベルの自己改善AIの研究コミュニティが2倍になるのに4年かかる場合彼ら自身の速度、次に2年、次に1年というように、彼らの能力は有限の時間で無限に増加します。[6] [106]

ヴィンゲの1993年の記事「来るべき技術的特異点:ポストヒューマン時代に生き残る方法」[7]はインターネット上で広く普及し、アイデアの普及に貢献しました。[107]この記事には、「30年以内に、超人間的な知性を生み出す技術的手段があります。まもなく、人間の時代は終わります」という声明が含まれています。ヴィンジは、サイエンスフィクションの作者は、人間の知性を超える現実的な特異点後のキャラクターを書くことはできないと主張しています。そのような知性の考えは、人間が表現する能力を超えているからです。[7]

2000年には、ビル・ジョイ、著名な技術者との共同創設者Sun Microsystemsが、特異点の潜在的な危険性について懸念を表明しました。[44]

2005年、カーツワイルは「シンギュラリティは近い」を発表しました。カーツワイルの宣伝キャンペーンには、ジョン・スチュワートとのデイリーショーへの出演が含まれていました。[108]

2007年、Eliezer Yudkowskyは、「特異点」に割り当てられたさまざまな定義の多くは、相互にサポートするのではなく、相互に互換性がないことを示唆しました。[19] [109]たとえば、カーツワイルは、自己改善AIまたは超人的知性の到来を過ぎた現在の技術的軌跡を推定している。ユドコウスキーは、IJグッドが提案した知性の不連続な上昇と、予測不可能性に関するヴィンジの論文の両方との緊張を表していると主張している。[19]

2009年、カーツワイルとXプライズの創設者であるピーターディアマンディスは、「人類の壮大な課題に取り組むために指数関数的技術を適用するようリーダーを教育し、刺激し、力を与える」ことを使命とする、認定されていない私立大学であるシンガラリティ大学の設立を発表しました。[110] Google、Autodesk、ePlanet Ventures、およびテクノロジー業界のリーダーのグループによって資金提供されているシンガラリティ大学は、カリフォルニア州マウンテンビューにあるNASAのエイムズ研究センターに拠点を置いています。 。非営利団体は、夏の間、毎年10週間の大学院プログラムを実施しており、10の異なるテクノロジーと関連トラック、および年間を通じて一連のエグゼクティブプログラムをカバーしています。

政治では

2007年、米国議会の合同経済委員会は、ナノテクノロジーの将来に関するレポートを発表しました。これは、技術的特異点の可能性を含め、中期的な将来における重要な技術的および政治的変化を予測します。[111] [112] [113]

![生物圏における情報とレプリケーターの概略タイムライン:Gillings etal。の情報処理における「主要な進化的遷移」。[87]](https://upload.wikimedia.org/wikipedia/commons/thumb/9/92/Major_Evolutionary_Transitions_digital.jpg/700px-Major_Evolutionary_Transitions_digital.jpg)

![2014年の世界中のデジタル情報の量(5×1021バイト)と世界中のヒトゲノム情報(1019バイト)。[87]](https://upload.wikimedia.org/wikipedia/commons/thumb/2/25/Biological_vs._digital_information.jpg/440px-Biological_vs._digital_information.jpg)

![このサンプルの再帰的な自己改善シナリオでは、AIのアーキテクチャを変更する人間は、実行可能なすべての改善を使い果たす前に、たとえば30世代にわたって3年ごとにパフォーマンスを2倍にすることができます(左)。 代わりに、AIが人間の研究者と同じように独自のアーキテクチャを変更できるほど賢い場合、再設計を完了するのに必要な時間は世代ごとに半分になり、実行可能な30世代すべてが6年間で進行します(右)。[91]](https://upload.wikimedia.org/wikipedia/commons/thumb/0/0a/Recursive_self-improvement.svg/700px-Recursive_self-improvement.svg.png)